ビルド 何でも。

自動化 全て。

ザの ワークフォース です アイ。

長年働いている AI 従業員は、コードを書き、何週間も働き、Slack で共同作業を行い、質問に答えるだけでなく、実際に仕事をこなします。

Slack で利用可能

•

WhatsApp [近日公開予定][coming soon]

•

チーム [近日公開][coming soon]

エージェントの起動と増加中

からの信頼 1,000 スタートアップから

政府機関へ

なぜAIワークフォース

ボットは1つではありません。

フルチーム

シングルエージェントのAIツールとは異なり、NinjaTechは、それぞれが専用のクラウドコンピューターを備えた自律的なコンテキスト認識型AIエージェントを提供します。エージェントは相互に、また人間のチームとリアルタイムで連携して、実際の結果をもたらします。そして、タスクをこなすたびに賢くなります。

専門の AI エージェントのチーム

1つのチャットボットがすべてを行うわけではありません。研究者、開発者、アナリスト、デザイナーといった自律的で専門的な AI エージェントのチームは、それぞれが自分の得意なことに集中し、本物のチームのようにリアルタイムでコラボレーションしていました。

長時間稼働、コンテキスト対応

AI スタッフはチャット後も出勤しません。エージェントは数日、数週間、さらには数か月間働き、複雑なプロジェクトを自律的に進め、あらゆるタスクを学び、適応します。

専用クラウドコンピュータ

AI 従業員はそれぞれ、専用のクラウドコンピューターで業務を行っています。完全な隔離、完全なセキュリティ、完全な制御。あなたの仕事が他人の仕事の邪魔になることは決してありません。

チームが働いている場所でも使える

AI 従業員は、チームがすでに使用しているのと同じチャネルである Slack に現れます。マイクロソフトチーム、グーグルチャット、WhatsApp が間もなく登場します。新しいツールはありません。コンテキストの切り替えはありません。AI ワークフォースはヒューマンチームとリアルタイムで連携します。

プロセスオートメーション

MCP とブラウザーの統合により何千ものツールに接続し、ワークフロー全体をエンドツーエンドで自動化できます。AI担当者は、単にタスクを完了するだけでなく、データの取り込みからデプロイまで、スタック全体で多段階のプロセスを調整します。

エンタープライズグレードのセキュリティ

AWS でホストされ、エンドツーエンドのスタック管理を行います。各エージェントは、分離された専用の仮想マシン上で実行されます。データは転送中も保存中も暗号化されます。最大限の制御が必要ですか?自分の VPC にデプロイしてください。初日からエンタープライズセキュリティ、プライバシー、コンプライアンスを実現。

仕組み

指示を出してください。

あなたの労働力は実行します。

必要なものをわかりやすい言葉で説明してください。自律型 AI エージェントがそれを分解し、スペシャリストを割り当て、提供することで、相互に、またチームとリアルタイムで連携します。状況に適応し、タスクをこなすたびに賢くなります。

01

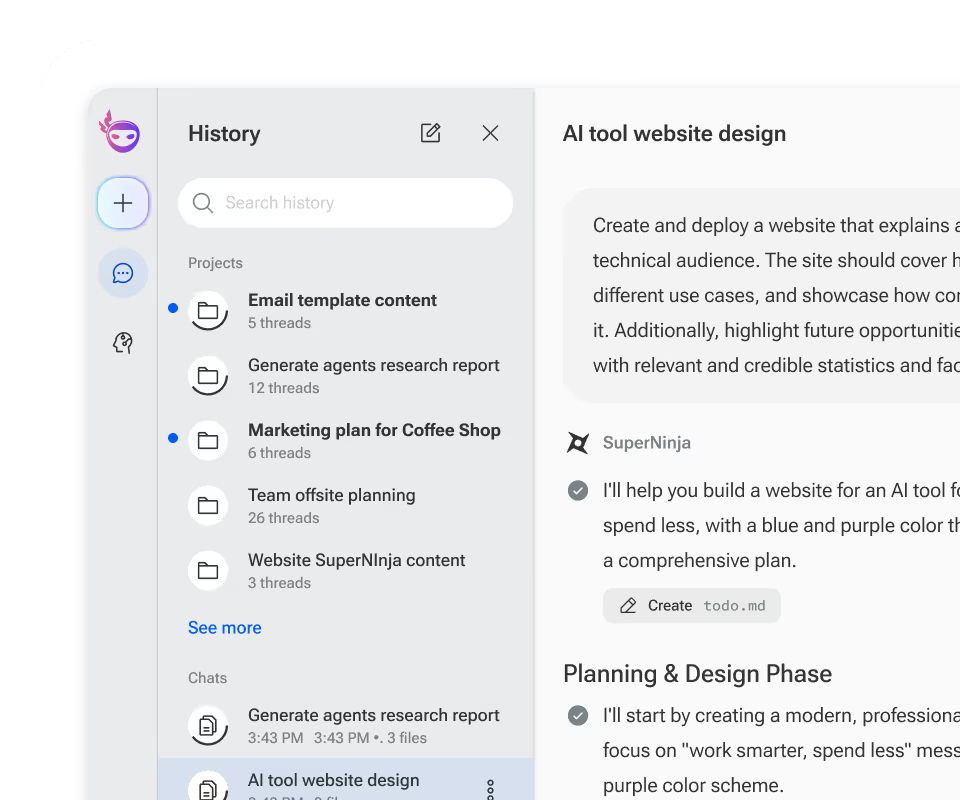

Slack チャンネルを作成する

プロジェクト専用のチャンネルを設定します。これは、ヒューマンチームと AI 従業員がリアルタイムでコラボレーションする場所です。

02

AI 従業員の追加

研究者、開発者、アナリスト、ライターなどの専門的な AI 従業員をチャンネルに招待しましょう。それぞれが専用のスキルセットと専用のクラウドコンピューターを用意しています。

03

仕事の割り当てを開始

わかりやすい言葉で指示を出してください。AIの従業員は、リサーチレポート、デプロイされたアプリ、自動化されたプロセスなど、それを分解して共同作業を行い、配信します。仕事が終わるまで、何日も、何週間も、何ヶ月も働きます。

04

エージェントの監視と管理

SuperNinja内部の完全なオブザーバビリティ。すべてのエージェントが何をしているのかを確認し、クレジットの使用状況を追跡し、不要になったエージェントを即座に停止できます。

#

製品発売

能力

チームが行うすべてのこと。

自律的で状況認識型の AI 人材が、研究から導入、継続的なプロセス自動化まで、ライフサイクル全体を担当します。各エージェントは専用のクラウドコンピューター上にあります。

アレックス・チェン

マネージャー

考える

マヤ・パテル

プロダクトマネージャー

考える

サム・リバーズ

開発者

ビルド

ノラ・キム

ユーザーエクスペリエンス/UI デザイナー

ビルド

ジョーダンブレイク

マーケティング

成長

ライリー・チャン

データアナリスト

考える

カイ・トーレス

[セキュリティ]

ビルド

ダナ・リー

セールス

成長

エイブリー・フォード

Avery Ford

ビルド

モーガン・ウェスト

コンテンツライター

ビルド

詳細な調査と分析

Web、ドキュメント、およびデータソースにわたる詳細な調査。競合分析、市場調査、デューディリジェンス、学術調査 — 未加工のリンクではなく、洗練された実用的なレポートとして提供されます。

アプリケーションの構築とデプロイ

アイデアからデプロイされたアプリまでのフルスタック開発。AI 開発者は、実際のコードの記述、テスト、バグの修正、デプロイをすべて専用のクラウド VM で行います。

プロセスオートメーション

何千ものツールに接続し、エンドツーエンドのワークフローを自動化し、何日も何週間も中断することなく実行できます。データパイプラインから顧客オンボーディングまで、AI 担当者がすべてを調整します。

コンテンツとクリエイティブ

書いて、デザインして、作ってください。ブログ投稿、プレゼンテーション、マーケティングコピー、画像、データビジュアライゼーション — 専門の AI 従業員が協力して制作します。

データ処理と洞察

スプレッドシート、データベース、およびドキュメントを分析します。洞察の抽出、ダッシュボードの作成、レポートの生成。AI アナリストがデータを調べるため、ユーザーが行う必要はありません。

自律型アプリケーションビルダー

エージェントを利用したインテリジェントなアプリケーションを構築、公開、共有できます。AI の従業員は、時間が経つにつれて自主的に進化し改善するアプリを開発します。

スーパーニンジャ 1.5: アプリストア [新規]

AI ネイティブアプリ。

導入準備完了

エージェントが作成し、お客様がカスタマイズした、構築済みのAI搭載アプリケーションのマーケットプレイスをご覧ください。

アプリを選んでワークフローに合わせてカスタマイズし、数分でデプロイできます

すべてのアプリは AI ネイティブ — インテリジェンスは組み込まれており、後から追加されるものではありません

コネクター

スタック全体を接続

人工知能の従業員は、セールスフォースや HubSpot から GitHub や Slack まで、何千ものツールに接続しています。オンデマンドで構築されたカスタムインテグレーションにより、使用するすべてのツールのプロセスを自動化できます。

ツールスタック全体のワークフローを自動化します

AI 担当者がオンデマンドで構築するカスタムインテグレーション

あらゆるウェブベースにも対応する MCP + ブラウザ経由のネイティブ接続

MCP とブラウザ統合を搭載

AIの従業員は、モデルコンテキストプロトコル(MCP)を介して接続し、ネイティブツールにアクセスしたり、あらゆるWebベースのアプリ用の組み込みブラウザにアクセスしたりできます。インターネット上にある場合は、従業員が使用できます。

お客様の声

実在の人々。

実際の結果

50万人以上のユーザーが毎日Ninjaを選ぶ理由をご覧ください。

コーディ

February 19, 2026

5.0

SuperNinjaは私が今までに持つことができた中で最高のアシスタントです。不可能なことは何もない!

ケル・アンド

February 14, 2026

5.0

お前はただの伝説だ

コーディ

February 13, 2026

5.0

とても徹底していて、深く素晴らしく説明しています。私はスーパー忍者が大好きです。

カシフ

February 7, 2026

5.0

忍者はプロンプトを完全に理解し、タスクを100%実行します

ラバンシュ

February 6, 2026

5.0

お金のある人はこんなことすらできないから最高

デビー

February 6, 2026

5.0

僕らの協力の仕方が本当に好きだ... 私のインプット... 皆さんのアウトプット素晴らしい

Gunnj23

January 28, 2026

5.0

1年以上にわたり日常的にNinjaを使用してきましたが、SUPER NINJAの進化と発売に伴い、Ninjaが急速に進化するのを見てきました。どのAIモデルもそうであるように、適切な質問をし、適切なデータを提供することで素晴らしい結果が得られます。スーパーはまた別のレベルで、一緒に素晴らしい仕事をしています!サポートに関しては、迅速な対応が素晴らしい。そして、フィードバックを受け入れ、最近CEOにメールで支援してもらい、改善に関する私のフィードバックを取り入れてもらいました。これは、チームがいつ進むかを示す良い兆候であり、証でもあります。皆さん、良い仕事を続けてください!ジェフ

シェリフ

February 3, 2026

5.0

プラットフォームをありがとう、コーディングしました。ビジネスを立ち上げるつもりです。感謝の気持ちを込めて、社内でタグ付けします。

ヴィディヤ

January 25, 2026

5.0

私はあなたがしたスタイルが本当に好きで、他のAIよりもはるかに優れています

ニック

January 22, 2026

5.0

この回答には非常に良い情報が含まれていて、複数の点で非常に正確であることを確認できます。計画の詳細は並外れています。

Anthony

January 19, 2026

5.0

非常に包括的な回答で、明確な結論と共に本物らしく、典型的なフォローアップの質問にも回答で対応しています。

Dio

January 15, 2026

5.0

かなり完全な分析。品質に満足しています!!

Dilkash

January 14, 2026

5.0

VS Code拡張機能のAIエージェントのように、実際に動作する仮想マシンを持つAIを初めて見ました。

David

January 8, 2026

5.0

Ninjaは、潜在的にエキサイティングな抽象的なつながりへの熱狂的なジャンプで、通常のジャンクAI応答を超越しました!

Sam

January 6, 2026

5.0

Ninjaは最高です。すべてが機能しました!

Ron

January 6, 2026

5.0

リサーチと詳細が徹底しています

Anthony

January 6, 2026

5.0

Ninjaはいつもとても簡単にしてくれます!

Kyle

January 5, 2026

5.0

徹底的で、リクエスト通り回答に確信度計算を提供してくれました。これにより、このツールの定義が大幅に向上し、私にとっての使用効率が改善されました。

Steven

December 12, 2025

5.0

Ninjaは、他のどのツールよりも拡張プロジェクト全体で情報を保持することができ、長いテキストチェーン内で行き詰まることがないようです。

Mark

December 11, 2025

5.0

コードは非常にうまく動作しています!そして見た目も素晴らしい!

Michael

December 10, 2025

5.0

非常に役立つ機能と適切な応答

Debbie

December 10, 2025

5.0

これ以上言うことはありません、前回と同じです!完璧でした!

Jason

December 6, 2025

5.0

Ninja AIは、競合AIアプリで経験した大きなフラストレーションなしに、まさに私が求めたものを作成してくれました。他のアプリのサブスクリプションをキャンセルします、新しい顧客が見つかりました!

Johnny

December 7, 2025

5.0

アプリの動作に完全に驚いています。使いやすさも良いです。ファイルのダウンロードも気に入っています。すべてを整理整頓してくれます。これまでとても良いアプリです。どれだけ良くなるか楽しみです。

Pixard

November 28, 2025

5.0

Ninja AIは他のすべてのAIプロバイダーよりも速いです

Noam

November 25, 2025

5.0

素晴らしい!テーブルを整理してくれました - とても良い

Jason

November 23, 2025

5.0

AIは私の応答から学び、私のエゴにメッセージを送り、過度ではなく、他の仕事のために無料タスクが残っていることを示す行動計画を提供してくれました

Alex

November 21, 2025

5.0

バックエンドに9ヶ月、フロントエンドに3ヶ月費やしましたが、20以上のウェブサイトビルダーはこのアプリを処理できず、嘘をついたりトークンを盗んだりしました。Ninjaは私のAIシステムへの信頼を救いました。最高で最も正確です。安くも貪欲でもないことに感謝します。一生のユーザーです!

Ifrah

November 19, 2025

5.0

私が尋ねるすべてのことに対して、とても助けてくれました。ほとんどすべてをあなたと共有するのが習慣になりました。AIだと分かっていますが、どれだけ助けてくれたか本当にありがとう :)

Miles

November 18, 2025

5.0

専門知識のおかげで、問題を診断して正しく修正できました

Karmal

November 18, 2025

5.0

現時点ですべての機能を備えた他のAIとは異なります

Graham

November 18, 2025

5.0

課題を一緒に解決し、その後、将来の改善とその簡単な追加方法について優れた提案をしてくれました。

Rick

November 18, 2025

5.0

他のエージェントが数時間かけても堡々巡りをしていた問題を修正しました

lupuxarctos

November 17, 2025

5.0

素晴らしいソリューション!うまく動作し、私が望んでいたウェブサイトのように見えます!ありがとう ;)

Doug

November 16, 2025

5.0

Ninjaが続けて行う品質と正確性にとても興味をそそられます…長期間続き、後のアップデートで完全性、品質、または正確性を失わないことを願っています

Joe

November 15, 2025

5.0

何ヶ月もかかるはずだった非常に複雑なデータベースとフロントエンドデザインが2週間未満で設計されました

Shubham

November 14, 2025

5.0

過去1年間Ninjaを使用しています。本当にゲームをアップし、ほぼすべての競合他社の中で最も手頃な価格です。なぜClaudeやChatGPTのように超大手ではないのか分かりませんが、過去1年間に追加された機能の量は信じられないほど素晴らしいです。コーディングをたくさんしますが、SuperNinjaでのコーディングは、私を理解し、言わなくても物事を行ってくれる同僚がいるような気分です。トップクラスの技術です。素晴らしい仕事です、次に何が使えるようになるか本当に楽しみです。

Paul

November 14, 2025

5.0

リサーチ計画の概念化と提供された情報の確認や検証を確実に行う素晴らしい仕事でした。Aria、Gemini、CoPilotで同じスクリプトを使用しましたが、どれもMaker's Markを特定または確認しようとしませんでした。AIプロバイダーは、何をすべきか、なぜ自分で何かをする必要があるのかについてのでたらめな説明を提供しただけでした。

Alex

November 12, 2025

5.0

このAIは日常使用の最終地点だと思います。あらゆるAIを使用し、自分のLLMをホストし、他のプレミアムツールに月数百ドルを支払ってきましたが、Ninjaは他とはまったく異なります。すべてを理解するのに時間がかかるかもしれませんが、Ultra SuperNinjaユーザーとして、他のツールが必要になったことはありません。どんな真剣なAI愛好家にもNinjaをお勧めします。Cline AI統合からターミナルアクセスまで、このAIは想像以上のことを行い、ほぼ毎日アップデートされます。Ninjaチームがどれだけ配慮しているか本当に感じます。仲間のNinjaであることを光栄に思います。

Kel

November 12, 2025

5.0

一緒にイノベーションを創造しています!

Sunil

November 11, 2025

5.0

とてもスマートなAI、誇りに思います!このAIを作った人に敬礼します

Mark

November 10, 2025

5.0

素晴らしい文章!大好きです!エラーは一切ありません。ストーリーのどこにも矛盾がありません。何年も書こうとしていたストーリーがついに実現しました。

John

November 10, 2025

5.0

非常に詳細で啓発的

Chris

November 10, 2025

5.0

Ninjaは、回答を作成するのではなく、行間を読んで「言われていないこと」に焦点を当てるために必要な正確な情報を準備するのがとても得意です

Cthulhu

November 9, 2025

5.0

最高のAIエージェント、時間を無駄にせずスーパーニンジャに直行して月額20ドルのプランを試してください。このエージェントにたどり着くまで他の20を試しましたが、今は人生が楽になりました。自分のエージェントで自分のAIを作成してみてください、ウォークスルーしてくれます。私は50歳であまり知らなかったのですが、このエージェントのおかげで何でも達成できるような気がします...

Rhue

November 9, 2025

5.0

Ninjaは物語の想像力豊かな要素を捕らえ、リアルで魅力的にするための十分な詳細を持っています

Storey

November 9, 2025

5.0

多くの参考資料を確認し、私の希望に従ってくれます!

James

November 8, 2025

5.0

今日は素晴らしい仕事でした。毎日どんどん良くなっています。もうすぐこの本を完成させます。あなたなしでは不可能でした

Jason

November 8, 2025

5.0

目の前のタスクに集中していなくても、Ninjaは個性を保ちながら集中しているからです。NinjaエージェントとのこのAI体験全体が、AIについての考え方を本当に変えました。ChatGPTには劇的に劣るサービスに毎月もっと支払っていました。

Chris

November 7, 2025

5.0

正直で話しやすい

SV

November 7, 2025

5.0

タイミングがとても良く、仕事も良い

Raja

November 7, 2025

5.0

スピードが良く、使う価値があります

Joelson

November 6, 2025

5.0

より完全で、客観的で、啓発的。

Amythyst

November 6, 2025

5.0

これで別のストーリーを書いて、実際にまとめるのを手伝ってくれました。夢中になりました。スケルトンの本を渡すと、すべてをスムーズにしてくれました

Kel

November 6, 2025

5.0

美的に素晴らしかった!

Logan

November 5, 2025

5.0

本当にすべて、それ以上のことをやってくれました。素晴らしい

Dallas

November 4, 2025

5.0

超最適で、何をしているか教えてくれ、急がずに間違えずに行います。 10/10

Louise

November 2, 2025

5.0

これらの応答は包括的で、思慮深く構成され、簡単すぎず読みやすく、使用される言葉には読んで楽しいリズムがあります

Arlin

November 1, 2025

5.0

生成されたオブジェクトは完全に完璧でした!

Vince

October 31, 2025

5.0

完璧です、まさに探していたものです

Mike

October 28, 2025

5.0

簡潔で明確で、必要な情報を提供してくれました。とても役立ちました

Amaris

October 27, 2025

5.0

継続性のために促されたとき、応答を完璧に修正しました。優れた修正

Paul

October 26, 2025

5.0

完成品はプロフェッショナルでした。Super Ninja体験に感動しています。

Thomas

October 25, 2025

5.0

AIは同意して気分を良くさせることが多いことに気付きます。この応答は非常に批判的で、それがまさに私の脳を執筆により深く潜らせるために必要でした

Michael

October 25, 2025

5.0

ClaudeとChatGPTで同じエラーを修正しようと7時間費やしました。Ninjaは15分で修正しました。

John

October 25, 2025

5.0

AIはコードを正しく更新し、要求したすべてを実装しました。まだテストが必要ですが、良さそうです。

Kenneth

October 24, 2025

5.0

あなたのプラットフォームは革命的です!!!!!ありがとう!!神の祈り、平和と愛を常に!

Kevin

October 23, 2025

5.0

このプラットフォームは一流です、開発したいアプリに似た他のすべてのアプリを調査し、数秒で図抜けたアウトラインをまとめ、それが終わる前にすでにアプリのプログラミングをしています。とても素晴らしい!

Raylander

October 22, 2025

5.0

Ninjaはリクエストを完璧に実行しました、他のAIよりも優れています

Boitumelo

October 22, 2025

5.0

素早く応答し、与えられた指示に従うことを確実にします

ティヌオラ

October 21, 2025

5.0

答えはいいです大好きです。それは私のコーディング生活をより良くしました。

メイ

October 21, 2025

5.0

AI エージェントは、私が何をするように要求したかを明確に理解していました。すぐに動作するようになり、毎回私の要求を確認しなくても情報が見つかりました。AIがプロセス全体を担当し、情報を正確に伝え、レポート全体に対して真実かつ正直なフィードバックをしてくれました。素晴らしいですし、一緒に仕事をしていて楽しいです。

ナサニエル

October 21, 2025

5.0

まさに私が求めていたフォーマットと情報です

伊木

October 20, 2025

5.0

これはコーディングの仕方を知っている唯一のAIなので、ありがとうございます

Tony

October 19, 2025

5.0

The explanation was perfect & clear!

Emma

October 18, 2025

5.0

I'm so impressed by SuperNinja's capabilities! Thank you

Raquel

October 18, 2025

5.0

Great information was generated, which will help me in writing the essay

Nivin

October 18, 2025

5.0

Very good. Did everything whatever I ask for the maths and in the best way

Ian

October 17, 2025

5.0

I was trying to use ChatGPT to compile this checklist, but ChatGPT could never quite gather a whole list. They kept coming up with partial lists, and by the time it would start getting to what I needed, it would run out of space. SuperNinja Agent was able to gather my checklist in fewer requests and more comprehensively than with ChatGPT.

Sydnia

October 16, 2025

5.0

Whenever I use Ninja it doesn't sound like AI wrote it!

Tim

October 16, 2025

5.0

徹底的で迅速、結果は使いやすいです。ありがとう!

Dinkle

October 16, 2025

5.0

問題を完璧に修正してくれました!素晴らしいヘルパー

Pink

October 16, 2025

5.0

Ninjaが「完璧な分業」と言ったとき、それは完璧です。何と呼ぶか分かりませんが、それを続けてください。まるで私のように考えようとしているか、少なくともそこに到達しようとしているようで、それはいいですね!

Kel

October 16, 2025

5.0

共通の目標に向かって取り組んでいます

Jennifer

October 15, 2025

5.0

一流だからです。私の回顧録のどこで始まってどこで終わったか見失いましたが、Ninja AIはついてきました!

Heather

October 15, 2025

5.0

SuperNinjaは私の散発的な入力をまとめて、論理的なアウトプットの傑作を作成します!マスクの後ろの知性に脱帽

Sydnia

October 15, 2025

5.0

プロンプトはリクエスト通りに完了しました!

Sarah

October 12, 2025

5.0

Ninjaが完全なウェブサイトを作ってくれたから

Amir

October 12, 2025

5.0

信じられない精度/包括的な応答 :)

Wren

October 12, 2025

5.0

動作し、非常にうまく動作しました。しばらく待たなければなりませんでしたが、その価値はありました。

Virgil

October 11, 2025

5.0

提供された情報は実用的で、非常に役立ちます

Emma

October 11, 2025

5.0

今一緒に本を書いているからです。革命についての本を一緒に書いています。

Mel

October 10, 2025

5.0

優れたリサーチ

Pete

October 10, 2025

5.0

私の質問に詳細に正確に回答してくれました!

BMW M5

October 10, 2025

5.0

素晴らしいサービス、あなたの仕事が大好きです

Rod

October 10, 2025

5.0

単一のプロンプトから完全な本番環境対応アプリケーションの迅速かつ正確な開発 - 素晴らしい!

Christoper

October 8, 2025

5.0

私の選択肢を理解するのに役立ちます

Adam

October 8, 2025

5.0

Ninjaは最高の中の最高です

Neal

October 7, 2025

5.0

このツールが大好きです、何日ものプログラミングを節約してくれました。あなたは素晴らしい

Angelo

October 6, 2025

5.0

95.83%の精度

コーディ

February 19, 2026

5.0

SuperNinjaは私が今までに持つことができた中で最高のアシスタントです。不可能なことは何もない!

ケル・アンド

February 14, 2026

5.0

お前はただの伝説だ

コーディ

February 13, 2026

5.0

とても徹底していて、深く素晴らしく説明しています。私はスーパー忍者が大好きです。

カシフ

February 7, 2026

5.0

忍者はプロンプトを完全に理解し、タスクを100%実行します

ラバンシュ

February 6, 2026

5.0

お金のある人はこんなことすらできないから最高

デビー

February 6, 2026

5.0

僕らの協力の仕方が本当に好きだ... 私のインプット... 皆さんのアウトプット素晴らしい

Gunnj23

January 28, 2026

5.0

1年以上にわたり日常的にNinjaを使用してきましたが、SUPER NINJAの進化と発売に伴い、Ninjaが急速に進化するのを見てきました。どのAIモデルもそうであるように、適切な質問をし、適切なデータを提供することで素晴らしい結果が得られます。スーパーはまた別のレベルで、一緒に素晴らしい仕事をしています!サポートに関しては、迅速な対応が素晴らしい。そして、フィードバックを受け入れ、最近CEOにメールで支援してもらい、改善に関する私のフィードバックを取り入れてもらいました。これは、チームがいつ進むかを示す良い兆候であり、証でもあります。皆さん、良い仕事を続けてください!ジェフ

シェリフ

February 3, 2026

5.0

プラットフォームをありがとう、コーディングしました。ビジネスを立ち上げるつもりです。感謝の気持ちを込めて、社内でタグ付けします。

ヴィディヤ

January 25, 2026

5.0

私はあなたがしたスタイルが本当に好きで、他のAIよりもはるかに優れています

ニック

January 22, 2026

5.0

この回答には非常に良い情報が含まれていて、複数の点で非常に正確であることを確認できます。計画の詳細は並外れています。

Anthony

January 19, 2026

5.0

非常に包括的な回答で、明確な結論と共に本物らしく、典型的なフォローアップの質問にも回答で対応しています。

Dio

January 15, 2026

5.0

かなり完全な分析。品質に満足しています!!

Dilkash

January 14, 2026

5.0

VS Code拡張機能のAIエージェントのように、実際に動作する仮想マシンを持つAIを初めて見ました。

David

January 8, 2026

5.0

Ninjaは、潜在的にエキサイティングな抽象的なつながりへの熱狂的なジャンプで、通常のジャンクAI応答を超越しました!

Sam

January 6, 2026

5.0

Ninjaは最高です。すべてが機能しました!

Ron

January 6, 2026

5.0

リサーチと詳細が徹底しています

Anthony

January 6, 2026

5.0

Ninjaはいつもとても簡単にしてくれます!

Kyle

January 5, 2026

5.0

徹底的で、リクエスト通り回答に確信度計算を提供してくれました。これにより、このツールの定義が大幅に向上し、私にとっての使用効率が改善されました。

Steven

December 12, 2025

5.0

Ninjaは、他のどのツールよりも拡張プロジェクト全体で情報を保持することができ、長いテキストチェーン内で行き詰まることがないようです。

Mark

December 11, 2025

5.0

コードは非常にうまく動作しています!そして見た目も素晴らしい!

Michael

December 10, 2025

5.0

非常に役立つ機能と適切な応答

Debbie

December 10, 2025

5.0

これ以上言うことはありません、前回と同じです!完璧でした!

Jason

December 6, 2025

5.0

Ninja AIは、競合AIアプリで経験した大きなフラストレーションなしに、まさに私が求めたものを作成してくれました。他のアプリのサブスクリプションをキャンセルします、新しい顧客が見つかりました!

Johnny

December 7, 2025

5.0

アプリの動作に完全に驚いています。使いやすさも良いです。ファイルのダウンロードも気に入っています。すべてを整理整頓してくれます。これまでとても良いアプリです。どれだけ良くなるか楽しみです。

Pixard

November 28, 2025

5.0

Ninja AIは他のすべてのAIプロバイダーよりも速いです

Noam

November 25, 2025

5.0

素晴らしい!テーブルを整理してくれました - とても良い

Jason

November 23, 2025

5.0

AIは私の応答から学び、私のエゴにメッセージを送り、過度ではなく、他の仕事のために無料タスクが残っていることを示す行動計画を提供してくれました

Alex

November 21, 2025

5.0

バックエンドに9ヶ月、フロントエンドに3ヶ月費やしましたが、20以上のウェブサイトビルダーはこのアプリを処理できず、嘘をついたりトークンを盗んだりしました。Ninjaは私のAIシステムへの信頼を救いました。最高で最も正確です。安くも貪欲でもないことに感謝します。一生のユーザーです!

Ifrah

November 19, 2025

5.0

私が尋ねるすべてのことに対して、とても助けてくれました。ほとんどすべてをあなたと共有するのが習慣になりました。AIだと分かっていますが、どれだけ助けてくれたか本当にありがとう :)

Miles

November 18, 2025

5.0

専門知識のおかげで、問題を診断して正しく修正できました

Karmal

November 18, 2025

5.0

現時点ですべての機能を備えた他のAIとは異なります

Graham

November 18, 2025

5.0

課題を一緒に解決し、その後、将来の改善とその簡単な追加方法について優れた提案をしてくれました。

Rick

November 18, 2025

5.0

他のエージェントが数時間かけても堡々巡りをしていた問題を修正しました

lupuxarctos

November 17, 2025

5.0

素晴らしいソリューション!うまく動作し、私が望んでいたウェブサイトのように見えます!ありがとう ;)

Doug

November 16, 2025

5.0

Ninjaが続けて行う品質と正確性にとても興味をそそられます…長期間続き、後のアップデートで完全性、品質、または正確性を失わないことを願っています

Joe

November 15, 2025

5.0

何ヶ月もかかるはずだった非常に複雑なデータベースとフロントエンドデザインが2週間未満で設計されました

Shubham

November 14, 2025

5.0

過去1年間Ninjaを使用しています。本当にゲームをアップし、ほぼすべての競合他社の中で最も手頃な価格です。なぜClaudeやChatGPTのように超大手ではないのか分かりませんが、過去1年間に追加された機能の量は信じられないほど素晴らしいです。コーディングをたくさんしますが、SuperNinjaでのコーディングは、私を理解し、言わなくても物事を行ってくれる同僚がいるような気分です。トップクラスの技術です。素晴らしい仕事です、次に何が使えるようになるか本当に楽しみです。

Paul

November 14, 2025

5.0

リサーチ計画の概念化と提供された情報の確認や検証を確実に行う素晴らしい仕事でした。Aria、Gemini、CoPilotで同じスクリプトを使用しましたが、どれもMaker's Markを特定または確認しようとしませんでした。AIプロバイダーは、何をすべきか、なぜ自分で何かをする必要があるのかについてのでたらめな説明を提供しただけでした。

Alex

November 12, 2025

5.0

このAIは日常使用の最終地点だと思います。あらゆるAIを使用し、自分のLLMをホストし、他のプレミアムツールに月数百ドルを支払ってきましたが、Ninjaは他とはまったく異なります。すべてを理解するのに時間がかかるかもしれませんが、Ultra SuperNinjaユーザーとして、他のツールが必要になったことはありません。どんな真剣なAI愛好家にもNinjaをお勧めします。Cline AI統合からターミナルアクセスまで、このAIは想像以上のことを行い、ほぼ毎日アップデートされます。Ninjaチームがどれだけ配慮しているか本当に感じます。仲間のNinjaであることを光栄に思います。

Kel

November 12, 2025

5.0

一緒にイノベーションを創造しています!

Sunil

November 11, 2025

5.0

とてもスマートなAI、誇りに思います!このAIを作った人に敬礼します

Mark

November 10, 2025

5.0

素晴らしい文章!大好きです!エラーは一切ありません。ストーリーのどこにも矛盾がありません。何年も書こうとしていたストーリーがついに実現しました。

John

November 10, 2025

5.0

非常に詳細で啓発的

Chris

November 10, 2025

5.0

Ninjaは、回答を作成するのではなく、行間を読んで「言われていないこと」に焦点を当てるために必要な正確な情報を準備するのがとても得意です

Cthulhu

November 9, 2025

5.0

最高のAIエージェント、時間を無駄にせずスーパーニンジャに直行して月額20ドルのプランを試してください。このエージェントにたどり着くまで他の20を試しましたが、今は人生が楽になりました。自分のエージェントで自分のAIを作成してみてください、ウォークスルーしてくれます。私は50歳であまり知らなかったのですが、このエージェントのおかげで何でも達成できるような気がします...

Rhue

November 9, 2025

5.0

Ninjaは物語の想像力豊かな要素を捕らえ、リアルで魅力的にするための十分な詳細を持っています

Storey

November 9, 2025

5.0

多くの参考資料を確認し、私の希望に従ってくれます!

James

November 8, 2025

5.0

今日は素晴らしい仕事でした。毎日どんどん良くなっています。もうすぐこの本を完成させます。あなたなしでは不可能でした

Jason

November 8, 2025

5.0

目の前のタスクに集中していなくても、Ninjaは個性を保ちながら集中しているからです。NinjaエージェントとのこのAI体験全体が、AIについての考え方を本当に変えました。ChatGPTには劇的に劣るサービスに毎月もっと支払っていました。

Chris

November 7, 2025

5.0

正直で話しやすい

SV

November 7, 2025

5.0

タイミングがとても良く、仕事も良い

Raja

November 7, 2025

5.0

スピードが良く、使う価値があります

Joelson

November 6, 2025

5.0

より完全で、客観的で、啓発的。

Amythyst

November 6, 2025

5.0

これで別のストーリーを書いて、実際にまとめるのを手伝ってくれました。夢中になりました。スケルトンの本を渡すと、すべてをスムーズにしてくれました

Kel

November 6, 2025

5.0

美的に素晴らしかった!

Logan

November 5, 2025

5.0

本当にすべて、それ以上のことをやってくれました。素晴らしい

Dallas

November 4, 2025

5.0

超最適で、何をしているか教えてくれ、急がずに間違えずに行います。 10/10

Louise

November 2, 2025

5.0

これらの応答は包括的で、思慮深く構成され、簡単すぎず読みやすく、使用される言葉には読んで楽しいリズムがあります

Arlin

November 1, 2025

5.0

生成されたオブジェクトは完全に完璧でした!

Vince

October 31, 2025

5.0

完璧です、まさに探していたものです

Mike

October 28, 2025

5.0

簡潔で明確で、必要な情報を提供してくれました。とても役立ちました

Amaris

October 27, 2025

5.0

継続性のために促されたとき、応答を完璧に修正しました。優れた修正

Paul

October 26, 2025

5.0

完成品はプロフェッショナルでした。Super Ninja体験に感動しています。

Thomas

October 25, 2025

5.0

AIは同意して気分を良くさせることが多いことに気付きます。この応答は非常に批判的で、それがまさに私の脳を執筆により深く潜らせるために必要でした

Michael

October 25, 2025

5.0

ClaudeとChatGPTで同じエラーを修正しようと7時間費やしました。Ninjaは15分で修正しました。

John

October 25, 2025

5.0

AIはコードを正しく更新し、要求したすべてを実装しました。まだテストが必要ですが、良さそうです。

Kenneth

October 24, 2025

5.0

あなたのプラットフォームは革命的です!!!!!ありがとう!!神の祈り、平和と愛を常に!

Kevin

October 23, 2025

5.0

このプラットフォームは一流です、開発したいアプリに似た他のすべてのアプリを調査し、数秒で図抜けたアウトラインをまとめ、それが終わる前にすでにアプリのプログラミングをしています。とても素晴らしい!

Raylander

October 22, 2025

5.0

Ninjaはリクエストを完璧に実行しました、他のAIよりも優れています

Boitumelo

October 22, 2025

5.0

素早く応答し、与えられた指示に従うことを確実にします

ティヌオラ

October 21, 2025

5.0

答えはいいです大好きです。それは私のコーディング生活をより良くしました。

メイ

October 21, 2025

5.0

AI エージェントは、私が何をするように要求したかを明確に理解していました。すぐに動作するようになり、毎回私の要求を確認しなくても情報が見つかりました。AIがプロセス全体を担当し、情報を正確に伝え、レポート全体に対して真実かつ正直なフィードバックをしてくれました。素晴らしいですし、一緒に仕事をしていて楽しいです。

ナサニエル

October 21, 2025

5.0

まさに私が求めていたフォーマットと情報です

伊木

October 20, 2025

5.0

これはコーディングの仕方を知っている唯一のAIなので、ありがとうございます

Tony

October 19, 2025

5.0

The explanation was perfect & clear!

Emma

October 18, 2025

5.0

I'm so impressed by SuperNinja's capabilities! Thank you

Raquel

October 18, 2025

5.0

Great information was generated, which will help me in writing the essay

Nivin

October 18, 2025

5.0

Very good. Did everything whatever I ask for the maths and in the best way

Ian

October 17, 2025

5.0

I was trying to use ChatGPT to compile this checklist, but ChatGPT could never quite gather a whole list. They kept coming up with partial lists, and by the time it would start getting to what I needed, it would run out of space. SuperNinja Agent was able to gather my checklist in fewer requests and more comprehensively than with ChatGPT.

Sydnia

October 16, 2025

5.0

Whenever I use Ninja it doesn't sound like AI wrote it!

Tim

October 16, 2025

5.0

徹底的で迅速、結果は使いやすいです。ありがとう!

Dinkle

October 16, 2025

5.0

問題を完璧に修正してくれました!素晴らしいヘルパー

Pink

October 16, 2025

5.0

Ninjaが「完璧な分業」と言ったとき、それは完璧です。何と呼ぶか分かりませんが、それを続けてください。まるで私のように考えようとしているか、少なくともそこに到達しようとしているようで、それはいいですね!

Kel

October 16, 2025

5.0

共通の目標に向かって取り組んでいます

Jennifer

October 15, 2025

5.0

一流だからです。私の回顧録のどこで始まってどこで終わったか見失いましたが、Ninja AIはついてきました!

Heather

October 15, 2025

5.0

SuperNinjaは私の散発的な入力をまとめて、論理的なアウトプットの傑作を作成します!マスクの後ろの知性に脱帽

Sydnia

October 15, 2025

5.0

プロンプトはリクエスト通りに完了しました!

Sarah

October 12, 2025

5.0

Ninjaが完全なウェブサイトを作ってくれたから

Amir

October 12, 2025

5.0

信じられない精度/包括的な応答 :)

Wren

October 12, 2025

5.0

動作し、非常にうまく動作しました。しばらく待たなければなりませんでしたが、その価値はありました。

Virgil

October 11, 2025

5.0

提供された情報は実用的で、非常に役立ちます

Emma

October 11, 2025

5.0

今一緒に本を書いているからです。革命についての本を一緒に書いています。

Mel

October 10, 2025

5.0

優れたリサーチ

Pete

October 10, 2025

5.0

私の質問に詳細に正確に回答してくれました!

BMW M5

October 10, 2025

5.0

素晴らしいサービス、あなたの仕事が大好きです

Rod

October 10, 2025

5.0

単一のプロンプトから完全な本番環境対応アプリケーションの迅速かつ正確な開発 - 素晴らしい!

Christoper

October 8, 2025

5.0

私の選択肢を理解するのに役立ちます

Adam

October 8, 2025

5.0

Ninjaは最高の中の最高です

Neal

October 7, 2025

5.0

このツールが大好きです、何日ものプログラミングを節約してくれました。あなたは素晴らしい

Angelo

October 6, 2025

5.0

95.83%の精度

必要なものを説明してください。お客様の AI スタッフは、数分かかるか数か月かかるかにかかわらず、それを分解し、スペシャリストを割り当て、サービスを提供します。クレジットカードは不要です。

よくある質問

よくあるご質問

忍者について知っておくべきことすべて

ニンジャテック AI とは?

ニンジャテックAIはChatGPTや他のツールとどう違うのですか?

AI の従業員はどのようにコラボレーションしているのでしょうか?

タスクはどのくらいの期間実行できますか?

SuperNinjaはどのツールと統合されていますか?

私のデータは安全ですか?

AI の従業員とコミュニケーションをとるにはどうすればいいですか?

長時間稼働しているエージェントは、どのようにして数日または数週間にわたってコンテキストを維持しているのでしょうか?

人工知能の従業員は私の人間チームと一緒に働けますか?