Le raisonnement rentable est la clé des flux de travail Agentic

Chez Ninja AI, nous pensons que l'IA de pointe doit être à la fois puissante et accessible, afin d'aider les utilisateurs à augmenter leur productivité sans se ruiner. Au cours des deux dernières années, nous nous sommes concentrés sur la création d'un système de productivité agentique, en ajoutant continuellement les dernières avancées en matière d'IA à Ninja AI pour le rendre plus intelligent, plus rapide et plus performant.

En cours de route, nous avons introduit des fonctionnalités qui nécessitent des flux de travail d'agence sophistiqués, telles que Recherche approfondie et Analysis of files in several tours. Nous avons également lancé une version bêta d'un planning work flow, permettant à Ninja de négocier les horaires des réunions avec plusieurs participants par e-mail.

Au fur et à mesure que nous perfectionnons ces compétences, nous reconnaissons un besoin essentiel : améliorer l'intelligence et la prise de décision de Ninja. La réduction des erreurs dans les tâches à haut risque (par exemple, la modification des événements du calendrier) et la mise en place de flux de travail plus autonomes (par exemple, l'exécution de tâches composites qui interagissent avec des API et des personnes) obligent nos agents à prendre des décisions et à faire des prévisions plus précises dans de nombreux types de situations.

Nous avons découvert que l'intégration d'une « réflexion étape par étape » dans nos flux de travail améliore considérablement leur précision et leur capacité à généraliser. La réflexion étape par étape est un processus qui implique : planifier, décomposer les tâches, revenir en arrière, vérifier et réfléchir avant d'exécuter des tâches en appelant des fonctions intelligentes. Des modèles de raisonnement récents ont appliqué avec succès la « réflexion étape par étape » pour résoudre des problèmes mathématiques, scientifiques et de codage complexes. Cependant, en raison des limites suivantes, ces modèles ne sont pas adaptés à notre flux de travail Ninja Agentic :

Tout d'abord, la plupart des modèles de raisonnement actuels sont très coûteux. Par exemple, une seule tâche agentique complexe utilisant API O1 d'OpenAI pourrait coûter entre 0,75$ et 2,25$1 - il s'agit du coût « par tâche », un prix qui n'est pas viable sur le plan économique pour nous en tant qu'entreprise et qui n'est pas non plus viable pour les clients si nous leur répercutions les coûts par tâche.

1En supposant que chaque tâche agentique nécessite environ 5 000 à 10 000 jetons d'entrée et 10 000 à 30 000 jetons de sortie

Ensuite, les modèles de raisonnement les plus abordables ne disposent pas des fonctionnalités nécessaires pour optimiser les flux de travail des agences. Par exemple, DeepSeek R1 est un modèle de raisonnement libre, mais il est limité. En raison de sa taille, la R1 nécessite des GPU Nvidia H200s (ou mieux) pour une latence élevée et un faible débit pour le modèle, ce qui rend difficile son utilisation dans un système de discussion en temps réel axé sur les tâches. L'utilisation des H200 rend également leur fonctionnement coûteux. En outre, R1 a des difficultés à gérer les tâches générales de capacité et de génie logiciel. Ces limites sont confirmées par la dernière section du Papier R1.

De plus, les modèles de raisonnement existants ne sont pas personnalisés. Chez Ninja, nous aspirons à créer le système d'agence le plus avancé en matière de productivité. Nous devons donc être en mesure d'ajuster les modèles pour mieux répondre à nos besoins. Cela n'est pas possible lorsque vous accédez aux modèles de raisonnement actuels via une API ou que vous utilisez de grands modèles de raisonnement open source existants (tels que le paramètre 671B R1).

Compte tenu de ces inconvénients, nous avons décidé de concevoir notre propre système de raisonnement, SuperAgent-R 2.0, pour nous aider à mettre en place un système d'agence durable, rapide, abordable et parfaitement ajustable pour les clients. \

Le modèle de raisonnement de Ninja - SuperAgent-R 2.0

SuperAgent-R 2.0 est un système d'IA composé: il exploite le modèle affiné de Ninja doté d'une capacité de raisonnement, basé sur le DeepSeek R1 distillé sur Llama 70B. Le SuperAgent-R 2.0 utilise également d'autres modèles pour soutenir le raisonnement via des optimisations avancées du niveau d'inférence. L'ensemble du système fonctionne de bout en bout sur l'infrastructure AWS, ce qui le rend abordable et évolutif. Le résultat final offre des performances proches de la pointe de la technologie à une fraction du coût des modèles propriétaires tels que O d'Openai, O3-mini (high) ou Anthropic Sonnet 3.7 (mode réflexion).

SuperAgent-R 2.0 réunit plusieurs innovations inédites dans le secteur pour créer un système capable d'effectuer des tâches de raisonnement complexes à faible coût. Un élément clé du système est une nouvelle approche de raisonnement multi-engrenages. Contrairement à d'autres modèles qui obligent les utilisateurs à effectuer un niveau de calcul fixe, notre système ajuste dynamiquement l'effort de raisonnement en fonction de la complexité des tâches. Les niveaux de calcul du SuperAgent sont les suivants :

- Aucune réflexion : pour des recherches simples et des réponses rapides.

- Pensée légère — Pour les tâches de complexité moyenne, comme le raisonnement structuré.

- High Thinking — Pour des tâches de raisonnement approfondies en plusieurs étapes nécessitant une logique avancée.

SuperAgent-R 2.0 peut déterminer lui-même l'effort de raisonnement et s'adapter automatiquement à une demande de l'utilisateur. Il est vrai que cela est difficile à réaliser à tout moment car le système peut encore trop réfléchir. Nous étudions en permanence les commentaires de nos clients et continuerons à apporter des améliorations.

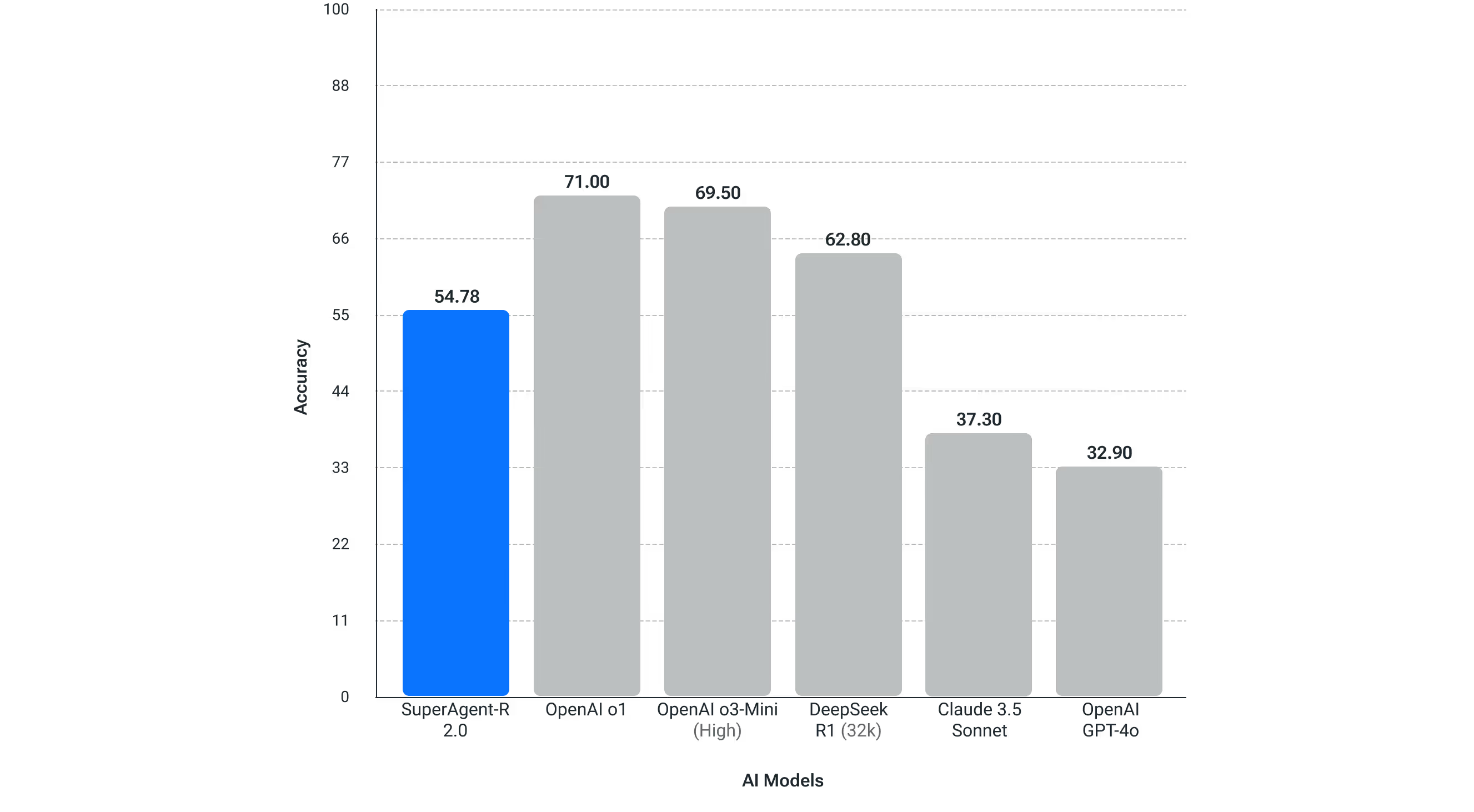

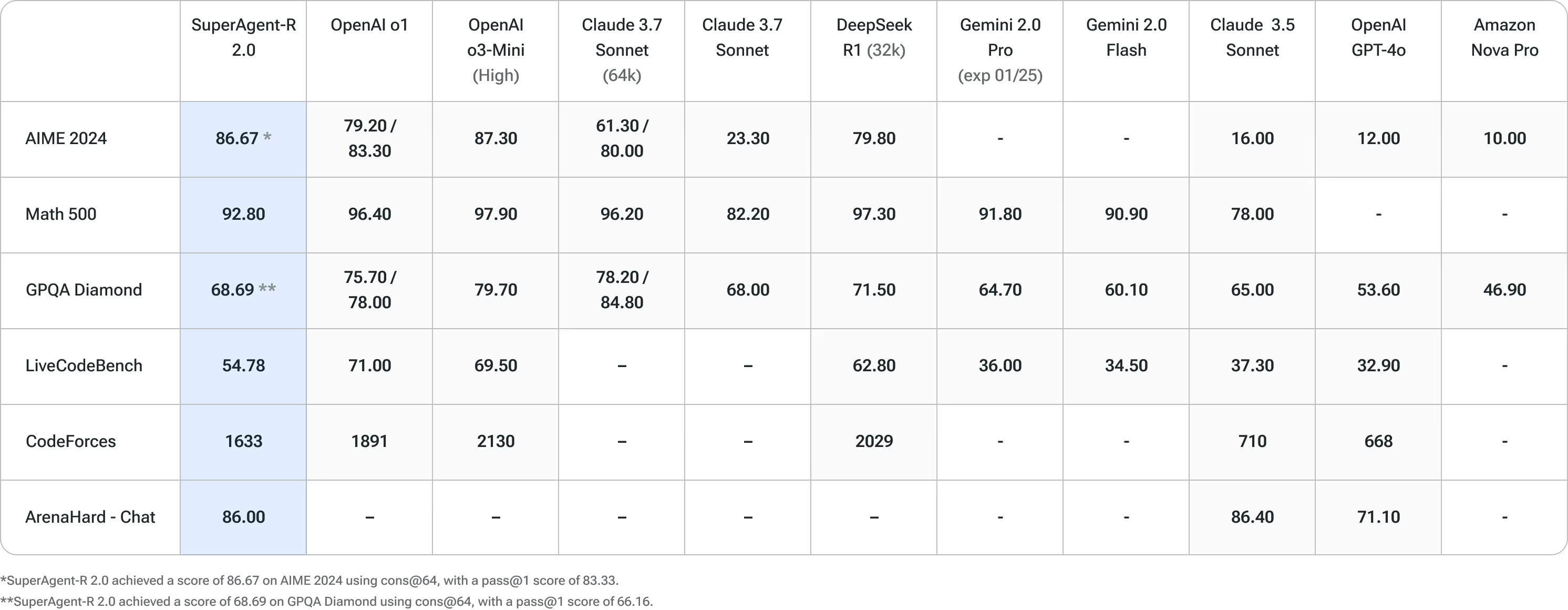

SuperAgent-R 2.0 a été soumis à des tests rigoureux par rapport aux principaux benchmarks d'IA, démontrant les meilleures performances de sa catégorie dans de nombreux domaines. Lors de ces tests, SuperAgent-R 2.0 est constamment en concurrence avec les principaux modèles d'IA, prouvant ainsi ses capacités supérieures de raisonnement et de résolution de problèmes.

Les avantages de SuperAgent-R 2.0 par rapport à DeepSeek R1

DeepSeek-R1, à juste titre, a récemment fait l'objet d'une grande attention en tant que modèle de raisonnement libre et de haute qualité. Cependant, il présente certains inconvénients notables. L'une des principales limites réside dans ses exigences matérielles (que nous avons mentionnées ci-dessus) : il doit fonctionner sur des GPU Nvidia H200 (ou mieux), ce qui peut augmenter les coûts d'exploitation ; et même dans ce cas, ce n'est pas un modèle rapide pour une inférence rapide en temps réel.

En outre, en évaluant DeepSeek-R1 et en revoyant sa documentation, nous avons identifié d'autres inconvénients susceptibles d'avoir un impact sur nos clients :

- Capacité générale : DeepSeek-R1 est en deçà de DeepSeek-v3 dans des domaines clés tels que l'appel de fonctions, les interactions multi-tours et les jeux de rôle complexes.

- Linguistic Capacités : DeepSeek-R1 est optimisé pour le chinois et l'anglais, ce qui peut entraîner des problèmes lors du traitement des requêtes dans d'autres langues. Étant donné que nous prenons en charge les utilisateurs dans plusieurs langues, une prise en charge linguistique plus étendue est essentielle.

- Sensibilité à l'incitation : DeepSeek-R1 is very sensitive to rapid variations. Les commandes à quelques reprises, qui sont courantes chez les clients, dégradent les performances globales, les rendant moins fiables pour répondre à nos besoins.

- Tâches de génie logiciel : les résultats de référence indiquent que DeepSeek-R1 possède des capacités d'ingénierie logicielle limitées. Étant donné que nombre de nos clients font confiance à Ninja pour les tâches liées aux logiciels, cette limitation aurait un impact significatif sur leur expérience.

DeepSeek R1 est un modèle fantastique, mais ces facteurs rendent DeepSeek R1 moins adapté à nos besoins et ont motivé notre décision de développer SeuperAgent-R 2.0.

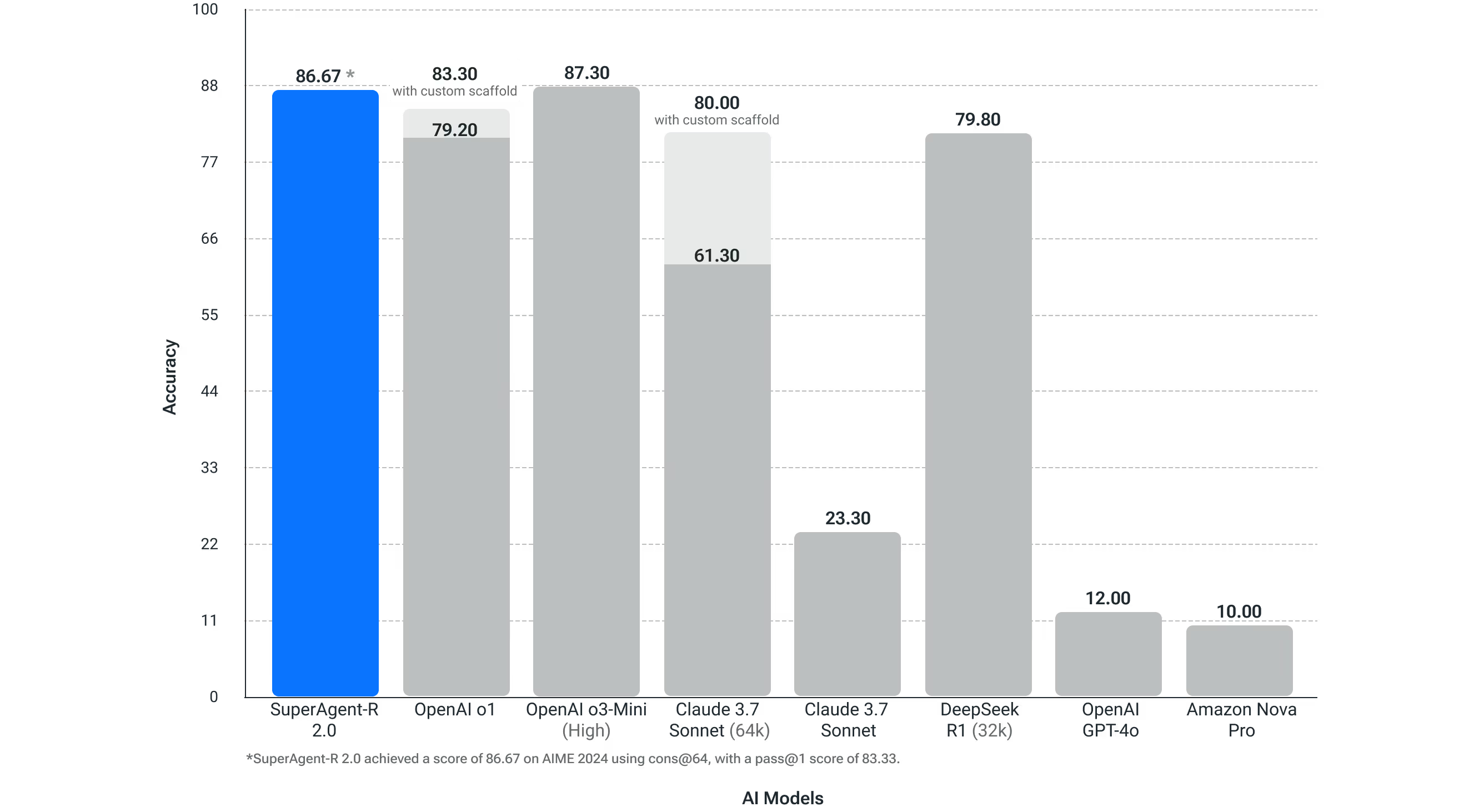

Compétition de mathématiques (AIME 2024)

En ce qui concerne les mathématiques compétitives, un déterminant de la capacité de raisonnement, nos tests ont montré que SuperAgent-R 2.0 dépasse les performances des modèles OpenAI O1, Sonnet 3.7 (64 000 capacités de réflexion étendues) et DeepSeek R1 et que SuperAgent-R 2.0 est comparable au modèle de raisonnement OpenAI O3 à haut niveau. OpenAI possède data publiées qu'un modèle performant en mathématiques compétitives, tel que AIME 2024, sera efficace pour les flux de travail autonomes des agences.

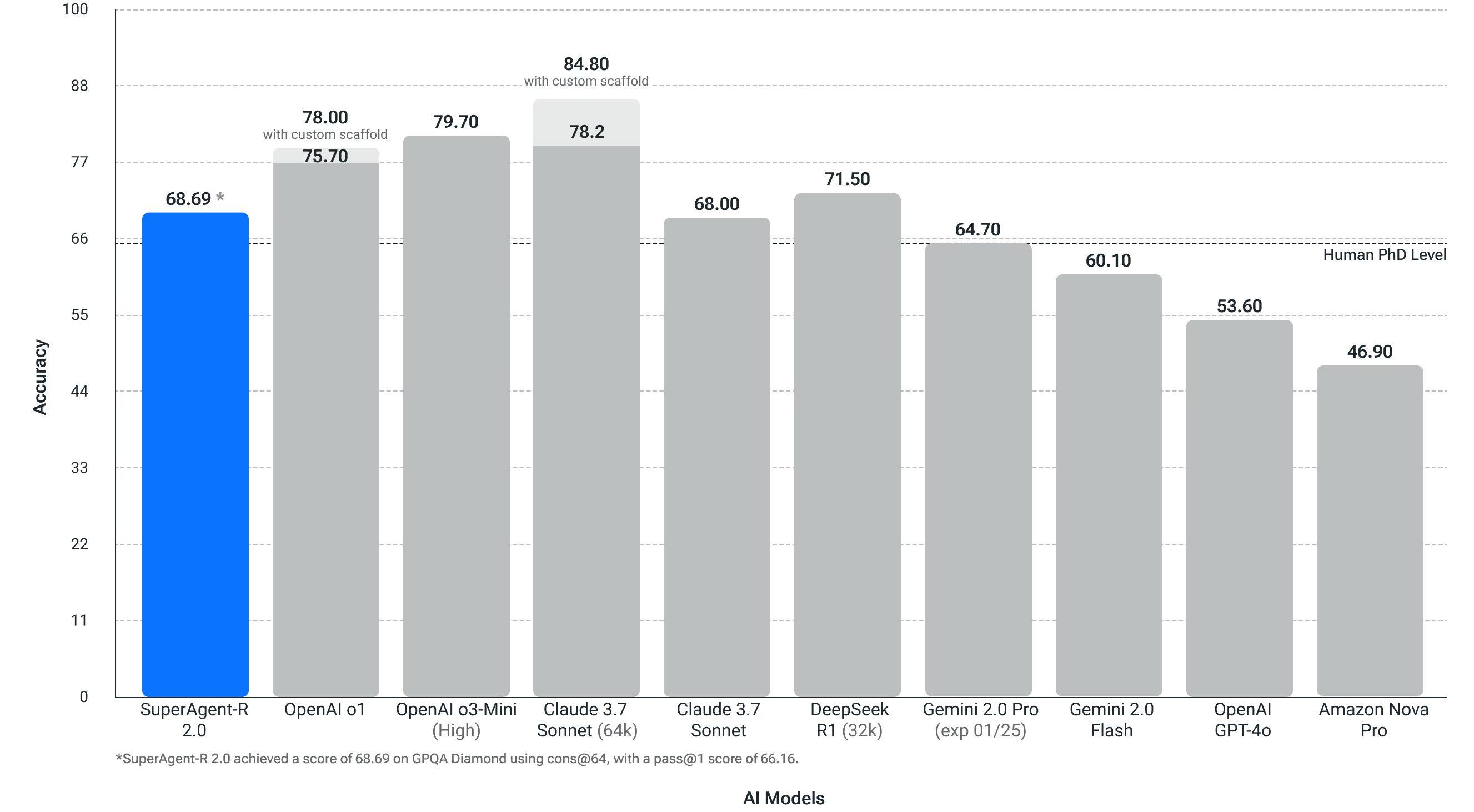

Questions scientifiques de niveau doctoral (GPQA Diamond)

Ce test mesure dans quelle mesure un système peut résoudre des questions scientifiques de niveau doctoral. Ce test est important pour nos utilisateurs qui travaillent dans de nombreux secteurs différents et occupent des fonctions variées. SuperAgent-R 2.0 a dépassé le niveau de précision du doctorat humain sur cette référence en matière de problèmes de physique, de biologie et de chimie.

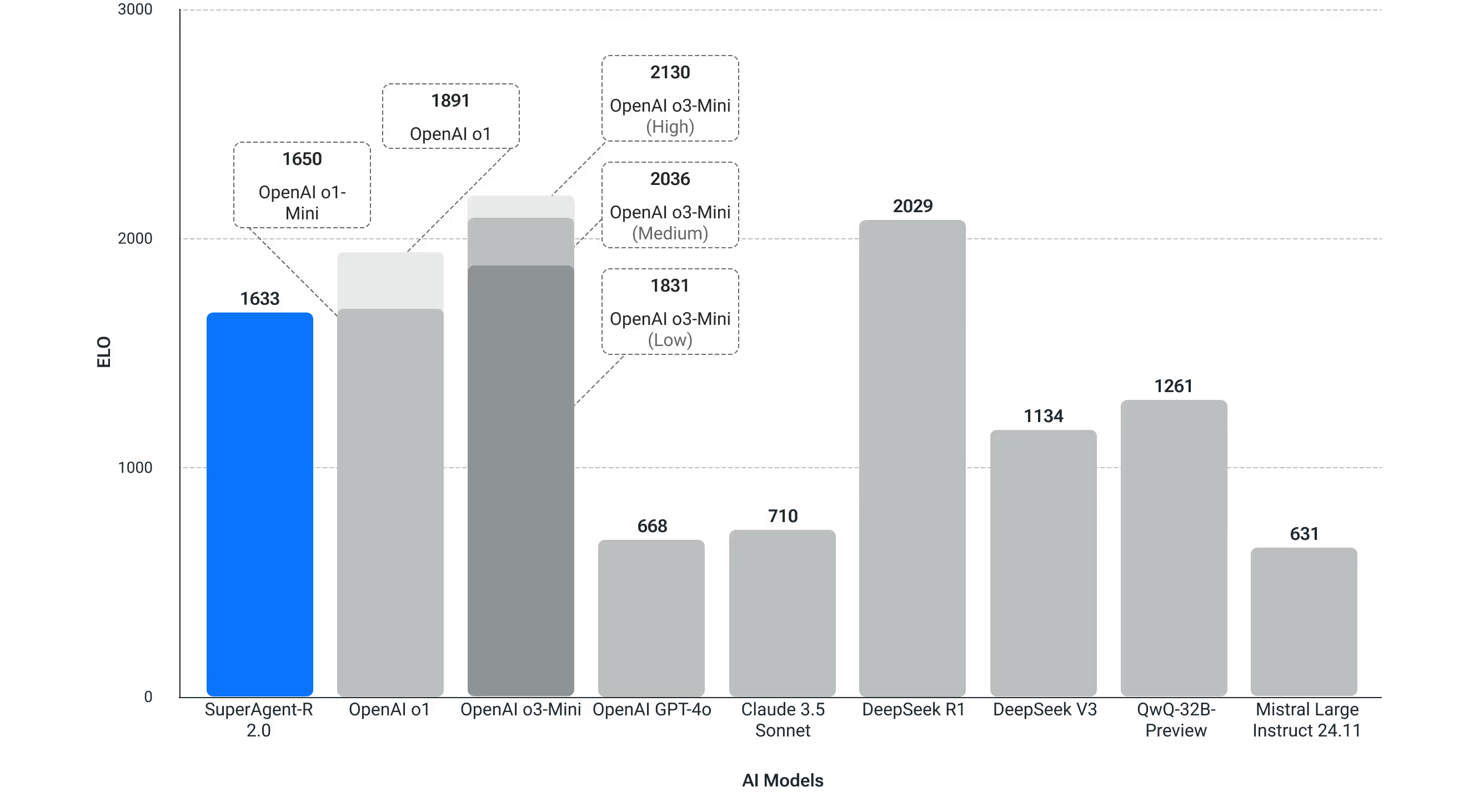

Code de la concurrence (Codeforces)

Sur la programmation compétitive de Codeforce, SuperAgent-R 2.0 obtient des scores ELO progressivement plus élevés que DeepSeek V3 et des scores compétitifs avec de nombreux modèles OpenAI.

LiveBench - Codage

Useed for tester les performances de codage dans le monde réel.

SuperAgent-R 2.0 est disponible à l'adresse myninja.ai

Contrairement à divers produits du marché, nous ne facturerons pas de frais d'abonnement supplémentaires pour un accès illimité au modèle SuperAgent-R 2.0. This model is available for all our Ultra users (15 $/mois) and the users of Business plan (20 $/mois/siège). Prixdetails. Veuillez noter que nous nous réservons le droit de limiter l'utilisation en cas d'utilisation excessive.

Essayez-le sur myninja.ai

Prochaines étapes : nouvelles compétences et accès aux API

À l'avenir, nous continuerons à proposer des flux de travail agentiques, optimisés par le SuperAgent-R 2.0, afin d'aider nos utilisateurs à être plus productifs. L'une des premières manières dont nous prévoyons d'utiliser SuperAgent-R 2.0 est d'améliorer notre fonctionnalité DeepResearch.

Nous prévoyons également de fournir prochainement un accès API à SuperAgent-R 2.0, afin d'aider les développeurs et les entreprises à créer leurs propres systèmes personnalisés.